Klíčová slova: "senzory, bezpilotní, dpz, průzkum, dálkový"

Ing. Jan Lukáš, Ph.D.

Intenzifikace a zprůmyslnění zemědělství ve 20. století vycházelo z požadavku maximalizace výnosu a představy uniformity obhospodařovaných pozemků. Mozaikovitá struktura políček se proměnila v rozlehlé lány spolu se ztrátou konektivity agroekosystémů na přirozené ekosystémy. Pole přestala být vnímána jako komplexní biologický systém a stala výrobním zdrojem. Znovu nabytí uvědomění funkce agroekosystémů přináší na začátku 21. století paradoxně technika v podobě senzorů umožňujících popis heterogenity prostředí půdy, rostlin a abiotických složek prostředí spolu s dostupností přesné GPS technologie, GIS řešení a satelitního snímání ve vysokém rozlišení v široké spektrální oblasti. Odpovědí je realizace konceptu precizního zemědělství, které pracuje s heterogenitou jako základním nástrojem pro popis situací, které se odehrávají v polních podmínkách.

Precizní zemědělství intenzivně využívá data z dálkového průzkumu země (DPZ) nebo též distanční data. DPZ představuje soubor technik, které umožňují získávání informací o objektech a jevech na zemském povrchu bez potřeby jakéhokoliv kontaktu s nimi. Takto je například umožněno provádění různých analýz opakovaně právě proto, že celý proces probíhá v nedestruktivním módu. V posledních letech se tyto metody dostávají do stále širšího povědomí veřejnosti, neboť jejich využití je s postupným vývojem technologií jednoduché, přesné a ekonomicky dostupné. Obecně lze problematiku DPZ rozdělit na dvě oblasti. Podstatou první je sběr dat ve formě obrazových dat. Ta jsou získávána pomocí senzorů, které zaznamenávají intenzitu elektromagnetického záření v různých intervalech vlnových délek s různou šířkou konkrétních pásem. Analýza a interpretace obrazových dat ve formě snímku či scény pak tvoří samostatnou oblast DPZ.

Zemědělská rostlinná produkce je mimořádně citlivá vůči abiotickým i biotickým podmínkám prostředí a agrotechnickým zásahům. V řízení zemědělské produkce je strategické rozhodování a časování zásahů s ohledem na proměnlivost přírodního prostředí (počasí), polní heterogenitu (půda, voda, živiny, odrůdy, choroby, škůdci) a fluktuaci trhu (ceny komodit, dotace, zemědělské politika. Jakýkoliv nástroj, který umožní včas podchytit dynamiku těchto procesů a účinně s nimi v kontextu přírodních a ekonomických podmínek pracovat, přinese zemědělci přidanou hodnotu v podobě optimalizace nákladů, zisku a pozitivních externalit spojených s kvalitou produkce a ochranou životního prostředí. Jedním z nejslibnějších nástrojů jsou v současné době bezpilotní prostředky, které představují technickou platformou pro senzory potřebné pro sběr dat v zemědělství. Oproti tradičním pilotním platformám (letadla, helikoptéry) disponují několika přednostmi: bezpečnost, opakovatelnost, nízké operační i pořizovací náklady, menší omezení spojené s meteorologickými podmínkami (bezpilotní prostředky létají pod mraky). Souběžná dostupnost všech těchto výhod je však závislá na velikosti a typu bezpilotních prostředků, výběru použitých senzorů, cíle letecké kampaně a legislativních omezení.

Senzorovou techniku (Obr.1) lze rozdělit do dvou kategorií na pasivní a aktivní senzory. Pasivní senzory zaznamenávají/měří přirozené záření odražené nebo emitované rostlinami. Aktivní senzory samy emitují záření a následně zaznamenávají/měří frakci odraženou od rostlin.

Obr. 1: Nejčastěji používané přístrojové senzory používané při snímání z bezpilotních prostředků. A. RGB kamera Autel, B. hyperspecktrální kamera Specim FX10, C. multispektrální kamera Dji phantom 4 multispectral, D. Kombinovaná multispektrální-rgb-termalní kamerara Micasence Altum PT, E. termokamera Flir Duo Pro R HD Dual-Sensor, F. LiDAR YellowScan

Pasivní senzory

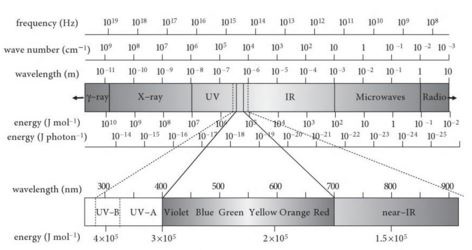

Pasivní senzory měří záření ve viditelném (0.4-0.7 μm) a infračerveném spektru (0.7-14μm) (Obr. 2). Optické senzory jsou závislé na slunečním záření, z čehož vyplývají i omezení spojené s proměnlivostí atmosférických jevů (mraky, mlha, kouř. Rozdílné výsledky mohou přinést také časové rozestupy mezi snímkováním. Pozemní optické senzory dnes mají možnost řešit tuto skutečnost pomocí přisvícení měřené plochy pomocí vysocesvítivých diod. Druhou možností, vhodnou i pro bezpilotní prostředky, je měření intenzity dopadajícího světla. Pomocí tohoto doplňkového měření a kalibrace snímků předejdeme rozdílům v odrazivosti sledovaného prostředí. V některých případech lze rovněž využít kalibrační desky se známou reflektací, které umístíme do blízkosti zájmového území. Tyto desky se fotí souběžně se zájmovou plochou a slouží následně pro kalibraci snímku.

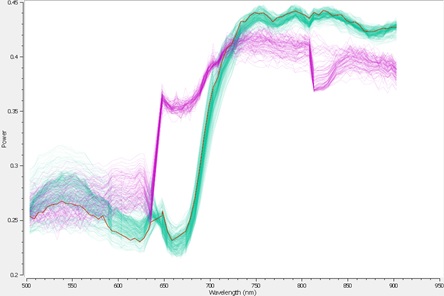

Optické senzory jsou blízké způsobu vnímání lidského oka. Fungují na principu záznamu/měření různého množství světla odraženého od povrchu ve specifických spektrálních pásmech (RGB - red, green blue)- Optické senzory mohou mít různé množství pásem o specifické šířce. Podle počtu spektrálních pásem se rozlišují optické senzory na panchromatické (1 široké pásmo, multispektrální (3-10 pásem) a hyperspektrální (10-100ky úzkých spektrálních pásem) (Obr. 3,4).

Obr. 3 Hyperspektrální snímané vrstvy podle vlnových délek (81 pásem) od 500 do 900nm.

Obr. 4. Změna průběhu odrazivosti rostlin nestresovaných (zelené křivky s vyznačeným průměrem-červeně) vůči situaci na rostlinách vystavených stresu (fialová barva).

Obr.2: Elektromagnetické spektrum (Jones et Vaughan, 2010).

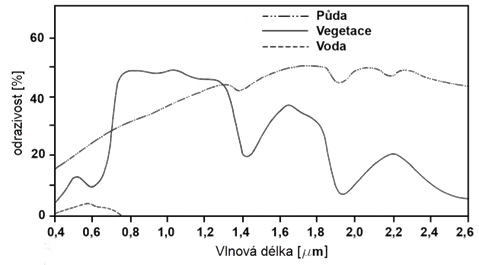

Typické křivky odrazivosti energie vegetací, půdou a vodou jsou vyobrazeny na obrázku 5. Tvar této křivky je jedinečný jak pro sledovaný objekt, je však ovlivňován i jeho stavem nebo kondicí. Jak je z obrázku patrné, jsou pro křivky zdravé vegetace typické vrcholky a sedla. Chlorofyl silně absorbuje záření v oblasti spektra od 0.45 μm do 0.67 μm (modrá a červená barva), ale zelenou barvu silně odráží. Pokud je vegetace stresována, obsah chlorofylu se snižuje. Tato skutečnost se projeví na poměru pohlcené a odražené energie. Především odrazivost červené složky se zvyšuje a výsledek je žloutnutí lisů (kombinace zelené a červené).

Obr. 5: Typické křivky odrazivosti spektra vegetace, půdy a vody (Lillesand a kol. 2004, upravil Kroulík).

Pokud se posouváme do oblasti blízkého infračerveného záření (near-IR, NIR), okolo vlnové délky 0.7 μm, začne u zdravé vegetace odrazivost výrazně narůstat. V rozsahu vlnových délek od 0.7 μm do 1.3 μm listy rostlin odrazí 40 až 50 % dopadající energie. Většina zbývající energie je propuštěno, protože v této oblasti je absorpce minimální (menší než 5 %). Odrazivost v tomto pásmu je dána především rozdílnou vnitřní strukturou listů. Protože struktura listů je mezi druhy rostlin velmi variabilní, měření odrazivosti v této oblasti nám často dovoluje rozlišit rostlinné druhy, i když ve viditelném spektru vypadají stejně. Rovněž se v blízkém infračerveném záření významně projeví stres rostlin.

Pokles v odrazivosti je pozorován v zónách vlnových délek 1.4, 1.9 a 2.7 μm, protože v těch je energie silně absorbována vodou v listech. S odvoláním na tuto skutečnost je uvedené pásmo nazýváno pásmo vodní absorpce. Vrchol odrazivosti se nachází v oblasti 1.6 μm a 2.2 μm. V celém pásmu, kromě délky 1.3 μm, listová odrazivost negativně koreluje s obsahem vody v listech.

Křivka odrazivosti půdy vykazuje mnohem méně výkyvů. Mezi faktory, které mají dopad na půdní odrazivost, patří vlhkost půdy, zrnitostní složení, drsnost povrchu, oxidy železa a organická hmota. Například vyšší vlhkost v půdě sníží její odrazivost. Stejně jako u vegetace je tento jev nejvýraznější v pásmu absorpce vody okolo 1.4, 1.9 a 2.7 μm. Vlhkost půdy úzce souvisí se zrnitostním složením. Hrubá písčitá půda je obvykle odvodněna a výsledkem je nižší vlhkost a relativně vysoká odrazivost. Jemná struktura bez přirozené drenáže bude mít nízkou odrazivost. Při absenci vody však bude půda samotná vykazovat opačné výsledky. Hrubší textura půdy se bude jevit tmavší než jemná textura. Další dva faktory, které redukují odrazivost, jsou drsnost povrhu půdy a obsah organické hmoty.

Pro záznam infračerveného záření jsou v oblastech 8 až 14 μm používány termokamery (Viz box Termální snímání a termokamery), kterým věnujeme v tomto článku zvýšený prostor s ohledem na jejich používání v našich pokusech a prezentované příklady..

Termální snímání a termokamery

Termokamera jako měřicí přístroj zaznamenává intenzitu tepelného záření vyzařovaného z povrchu měřených objektů. Na základě změřené intenzity vyzařování a zadaných parametrů je pak termokamera schopna výpočtem stanovit rozložení povrchové teploty. Výstupem z měření termokamerou je tzv. termogram (nesprávně též termovizní snímek, termosnímek apod.) (obr. 6). To je obdoba fotografie, tj. digitálního snímku, kdy ale jednotlivé pixely nenesou informaci o naměřeném jasu, nýbrž o povrchové teplotě snímaných objektů.

Obr. 6 Termogram ze snímání polního porost ozimé pšenice ukazuje významné teplotní rozdíly spojené s dostupností vody

Pro bezdotykové měření teploty je důležité vědět, že intenzita vyzařování z povrchu těles roste s jejich povrchovou teplotou. Tento fakt je možné využít právě při bezdotykovém měření teploty. První skutečně použitelné přístroje, které toho byly schopny, byly zkonstruovány okolo roku 1900. Jednalo se o tzv. pyrometry. Moderní termokamery využívají obrazové senzory a jsou schopny změřit povrchovou teplotu v 640x512 i více bodech. Tento údaj zároveň udává rozlišení výsledného termogramu. Čím větší je rozlišení termogramu, tím větší prostorové rozlišení lze při měření povrchové teploty získat.

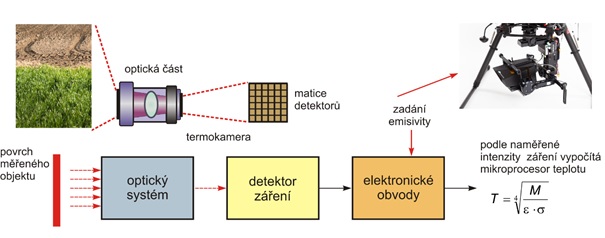

Z hlediska principu konstrukce (obr.7) jsou termokamery velmi podobné klasickým fotoaparátům s tím rozdílem, že je optickým senzorem je tzv. mikrobolometr a použitá optika nahrazuje křemíkové sklo germániem, kvůli propustnosti dlouhých vlnových délek. Detektor infračerveného záření převádí dopadající tepelné záření na elektrický signál, který je digitalizován a pak dále zpracováván. Vedle optiky se jedná o nejdůležitější součást termokamery a jeho konstrukce a princip funkce podstatným způsobem ovlivňuje parametry termokamery.

Nejčastěji používané termokamery snímají tepelné záření ve vlnovém pásmu přibližně 8 až 14 μm. Termokamery, které pracují v tomto vlnovém pásmu se označují jako LWIR (Long Wave InfraRed).

Obr. 7: Zjednodušené blokové schéma uspořádání měření povrchové teploty termokamerou. Tepelné záření, vyzařované měřeným objektem, se soustřeďuje optickým systémem na detektor termokamery. Optický systém funguje většinou i jako filtr a musí propouštět záření požadovaných vlnových délek.

Při měření teploty s pomocí termokamery je třeba vždy pamatovat na to, že termokamerou není přímo měřena (skutečná) absolutní teplota povrchu. Absolutní teplota může být termokamerou pro zemědělské účely stanovena po specifikaci parametrů měření - emisivity a odražené zdánlivé teploty.

Aktivní senzory.

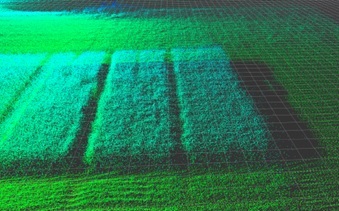

Jako zajímavá a perspektivní oblast využití bezpilotním prostředků se ukazuje jejich nasazení při tvorbě modelů terénu. Vrstevnicové modely často nevyhovují speciálním aplikacím, kdy potřebujeme znát velice přesně reliéf zájmového území. Kromě představené spektroskopie se uplatňuje laserového měření povrchu Země známé pod pojmem LIDAR. Obrázek 8 ukazuje scénu zachycenou 3D skenerem z pozemního měření. Ze signálu je vymodelován pohyb osob nebo překážky v okolí senzoru. Díky uvedenému měření můžeme kromě modelu terénu popisovat habitus rostlin a jejich zapojení.

Obr. 8: Vizualizace porostu v 3D prostoru na základě lidarového snímání

APLIKACE a příklady

Interpretace shromážděných dat z použitých senzorů je spojená s obrazovou analýzou. Ta umožňuje kvantifikovat jevy, které mají jak kvalitativní (úroveň zdraví, výživy a zralosti rostlin) tak kvantitativní (počty rostlin, velikost plochy, výšku rostlin, teplota) povahu.

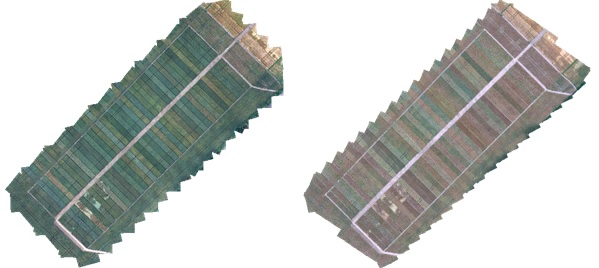

RGB fotoaparát představuje nejjednodušší aplikaci pro bezpilotní prostředky. Jedná se o snímkování ve viditelném spektru a výstupem je klasická fotografie. Jako prvotní aplikace se nabízí hodnocení variability pozemků, která je sice viditelná pouhým okem, nicméně pohled z výšky umožní s fotografií dále pracovat. Získáme tak významnou vrstvu do skladby informací o pozemcích. Výsledné snímky můžeme také zpětně využít při návrhu odběrové sítě (Obr. 9).

Obr. 9 Snímání v RGB spektru a hodnocení na základě časosběrného snímání z hlediska zrání a poškození porostu

Zajímavou oblastí využití klasického fotoaparátu je oblast stereoskopie. Pokud zájmové území nasnímáme v letovém režimu s vysokým stupněm překrytí, výškopisný vjem získáme spojením snímků do jedné vrstvy. Tímto postupem vytvoříme velmi podrobné, detailní modely terénu s měřítkem v řádu milimetrů nebo centimetrů. Dostáváme se tak na měřítko, kdy můžeme sledovat jednotlivé rostliny, kolejové stopy, hrudovitost, erozní rýhy a podobně.

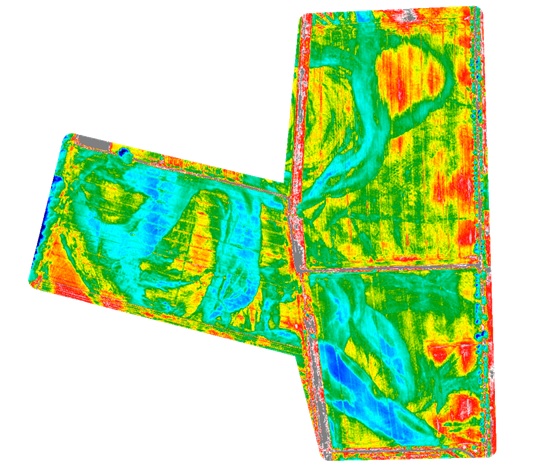

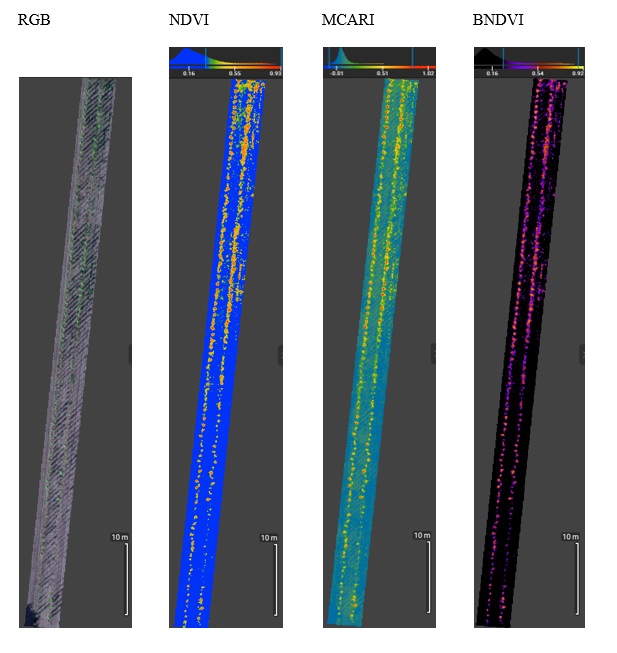

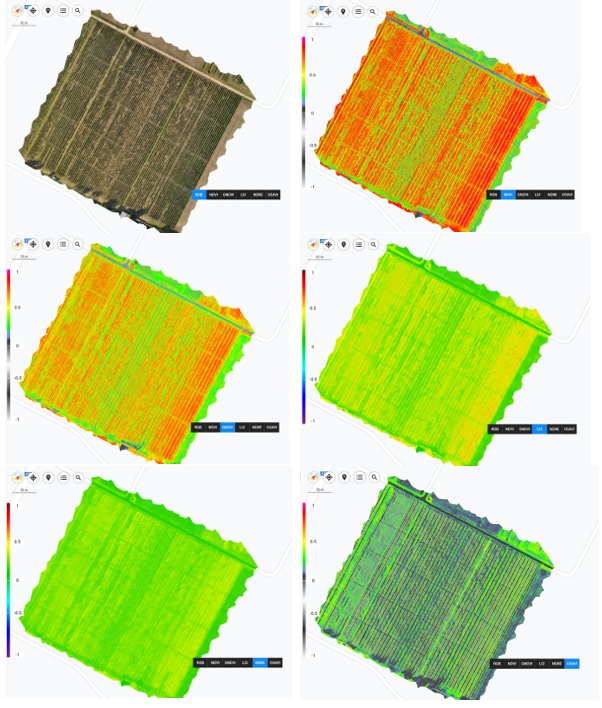

Spektrální a teplotní chování rostlin a půdy se s vlnovými délkami mění. Struktura a fyziologie porostu či jednotlivých rostlin ovlivňují jejich spektrální odrazivost, tedy množství odraženého záření. Snímky zobrazené ve viditelné části spektra (RGB) nám odkryjí jenom část toho, co se aktuálně děje ve sledovaném porostu. K tomu, abychom zjistili požadovanou informaci (obsah vody, chlorofylu, vodní stres...), je potřeba využít kombinaci jednotlivých spektrálních pásem v předem definovaném tvaru. Takovýmto kombinacím pásem se říká spektrální či vegetační indexy. Každý z indexů má svůj účel použití. Širokopásmové indexy využívají pásma z multispektrálních kamer a závisejí především na spektrálním rozlišení snímku. Spektrální indexy zpravidla obsahují kombinaci pásem, kde můžeme detekovat vysokou odrazivost (pásma GREEN a NIR), či pásma, kde dochází k absorpci elektromagnetického záření (pásmo RED). Chceme-li detekovat vodní stres rostlin, je možné použít index vlhkostního stresu (moisture stress index), který je založen na kombinaci pásem NIR a SWIR. Velmi oblíbeným spektrálním indexem je normalizovaný diferenční vegetační index, který je kombinací pásem NIR a RED. Tento index se zaměřuje na strukturu a zdravotní stav rostlin. Pomocí hyperspektrálních senzorů, kde jsou k dispozici desítky či stovky spektrálních pásem, je možné se zaměřit na taková pásma, která nám přesně charakterizují požadovaný stav, např. red edge pásmo – nárůst odrazivosti v intervalu vlnových délek 0,68 – 0,76 μm. V současné době jsou v moderních SW pro zpracování obrazových dat již spektrální indexy předdefinované, a proto není složité si vybrat a spočítat takový index, který potřebujeme Obr. 10, 11.

Obr. 10 Kolmý pohled na založený dvouřádkový pokus v Troji (Praha) v RGB zobrazení doplněný o vegetační indexy NDVI, MCARI a BNDVI

Obr. 11 Pokusná plocha 1 v Lednici s náhledem v RGB a přehledovou ukázkou vybraných vegetačních indexů generovaných z dat multispektrálního snímkování (NDVI, GNDVI, LCI, NDRE a OSAVI)

Literatura

Abdulridha, J., Ampatzidis, Y., Kakarla, S. C., & Roberts, P. (2019). Detection Of target spot and bacterial spot diseases in tomato using UAV-based and benchtop-based hyperspectral imaging techniques. Precision Agriculture, 21, 955– 978. https://doi.org/10.1007/s11119-019-09703-4

Aboutalebi, M., Allen, N., Torres-Rua, A. F., McKee, M., & Coopmans, C. (2019). Estimation Of soil moisture at different soil levels using machine learning techniques and Unmanned Aerial Vehicle (UAV) Multispectral Imagery. In Proceedings Volume 11008, Autonomous Air and Ground Sensing Systems for Agricultural Optimization and Phenotyping IV. https://doi.org/10.1117/12.2519743

Adamsen, F. J., Coffelt, T. A., Nelson, J. M., Barnes, E. M., & Rice, R. C. (2000). Method for Using Images from A Color Digital Camera to Estimate Flower Number. Crop Science, 40, 704– 709. https://doi.org/10.2135/cropsci2000.403704x

Aguera, F., Carvajal, F., & Pérez, M. (2012). Measuring Sunflower Nitrogen Status from An Unmanned Aerial Vehicle-Based System and An on The Ground Device. International Archives of The Photogrammetry, Remote Sensing and Spatial Information Sciences. 37, 33– 37. https://doi.org/10.5194/isprsarchives-XXXVIII-1-C22-33-2011

Albetis, J., Duthoit, S., Guttler, F., Jacquin, A., Goulard, M., Poilvé, H., & Dedieu, G. (2017). Detection of flavescence dorée grapevine disease using unmanned aerial vehicle (UAV) Multispectral imagery. Remote Sensing, 9(4), 308. https://doi.org/10.3390/rs9040308

Aldana-Jague, E., Heckrath, G., Macdonald, A., van Wesemael, B., & Van Oost, K. (2016). UAS-based soil carbon mapping using VIS-NIR (480–1000 NM) Multi-spectral imaging: Potential and limitations. Geoderma, 275, 55– 66. https://doi.org/10.1016/j.geoderma.2016.04.012

Alderfasi, A. A., & Nielsen, D. C. (2001). Use of crop water stress index for monitoring water status and scheduling irrigation in wheat. Agricultural Water Management, 47(1), 69– 75. https://doi.org/10.1016/S0378-3774(00)00096-2

Altas, Z., Özgüven, M. M., & Yanar, Y. (2018). Determination of sugar beet leaf spot disease level (Cercospora Beticola Sacc.) With image processing technique by using drone. Current investigations in Agriculture and Current Research, 5(3). 669– 678. https://doi.org/10.32474/CIACR.2018.05.000214

Ampatzidis, Y., & Partel, V. (2019). UAV-Based high throughput phenotyping in citrus utilizing multispectral imaging and artificial intelligence. Remote Sensing, 11(4), 410. https://doi.org/10.3390/rs11040410

Bah, M. D., Hafiane, A., & Canals, R. (2018). Deep learning with unsupervised data labeling for weed detection in line Crops in UAV Images. Remote Sensing, 10(11), 1690. https://doi.org/10.3390/rs10111690

Barnes, E. M., Sudduth, K. A., Hummel, J. W., Lesch, S. M., Corwin, D. L., Yang, C., & Bausch, W. C. (2003). Remote-and ground-based sensor techniques to map soil properties. Photogrammetric Engineering & Remote Sensing, 69(6), 619– 630. https://doi.org/10.14358/PERS.69.6.619

Barrero, O., & Perdomo, S. A. (2018). RGB and multispectral UAV Image fusion for gramineae weed detection in rice fields. Precision Agriculture, 19(5), 809– 822. https://doi.org/10.1007/s11119-017-9558-x

Bartholomeus, H., Kooistra, L., Stevens, A., Van Leeuwen, M., Van Wesemael, B., Ben-Dor, E., & Tychon, B. (2011). Soil organic carbon mapping of partially vegetated agricultural fields with imaging spectroscopy. International Journal of Applied Earth Observation and Geoinformation, 13(1), 81– 88. https://doi.org/10.1016/j.jag.2010.06.009

Boegh, E., Soegaard, H., Broge, N., Schelde, K., Thomsen, A., Hasager, C. B., & Jensen, N. O. (2002). Airborne multispectral data for quantifying leaf area index, nitrogen concentration, and photosynthetic efficiency in agriculture. Remote Sensing of Environment, 81, 179– 193. https://doi.org/10.1016/S0034-4257(01)00342-X

Bouroubi, Y., Bugnet, P., Nguyen-Xuan, T., Gosselin, C., Bélec, C., Longchamps, L., & Vigneault, P. (2018). Pest detection on UAV imagery using a deep convolutional neural network. International Conference on Precision Agriculture 2018. Retrieved from https://www.ispag.org/proceedings/?action=abstract&id=5136

Calderon, R., Navas-Cortés, J. A., Lucena, C., & Zarco-Tejada, P. J. (2013). High-resolution airborne hyperspectral and thermal imagery for early detection of verticillium wilt of olive using fluorescence, temperature, and narrow-band spectral indices. Remote Sensing of Environment, 139, 231– 245. https://doi.org/10.1016/j.rse.2013.07.031

Chatterjee, A., Olson, D., Franzen, D. W., & Day, S. S. (2019). Relationship of drone-based vegetation indices with corn and sugarbeet yields. Agronomy Journal, 111, 2545– 2557. https://doi.org/10.2134/agronj2019.04.0260

Condorelli, G. E., Maccaferri, M., Newcomb, M., Andrade-Sanchez, P., White, J. W., French, A. N., & Tuberosa, R. (2018). Corrigendum: Comparative aerial and ground based high throughput phenotyping for the genetic dissection Of NDVI as a proxy for drought adaptive traits in durum wheat, Frontiers in Plant Science, 9, 893. https://doi.org/10.3389/fpls.2018.00893

De Castro, A. I., Peña, J. M., Torres-Sánchez, J., Jiménez-Brenes, F., & López-Granados, F. (2017). Mapping cynodon dactylon in vineyards using UAV Images for site-specific weed control. Advances in Animal Biosciences, 8, 267– 271. https://doi.org/10.1017/S2040470017000826

Del-Campo-Sanchez, A., Ballesteros, R., Hernandez-Lopez, D., Ortega, J. F., & Moreno, M. A. & Agroforestry and Cartography Precision Research Group.(2019) Quantifying the effect of jacobiasca lybica pest on vineyards with UAVS by combining geometric and computer vision techniques. PLOS ONE, 14(4), e0215521. https://doi.org/10.1371/journal.pone.0215521

Dobbels, A. A., & Lorenz, A. J. (2019). Soybean iron deficiency chlorosis high throughput phenotyping using an unmanned aircraft system. Plant methods, 15(1), 97. https://doi.org/10.1186/s13007-019-0478-9

Floreano, D., & Wood, R. J. (2015). Science, technology and the future of small autonomous drones. Nature, 521, 460– 466. https://doi.org/10.1038/nature14542

Gibson-Poole, S., Humphris, S., Toth, I., & Hamilton, A. (2017). Identification of the onset of disease within a potato crop using a UAV equipped with un-modified and modified commercial off-the-shelf digital cameras. Advances in Animal Biosciences, 8, 812– 816. https://doi.org/10.1017/S204047001700084X

Gitelson, A. A., Gritz, Y., & Merzlyak, M. N. (2003). Relationships between leaf chlorophyll content and spectral reflectance and algorithms for non-destructive chlorophyll assessment in higher plant leaves. Journal of Plant Physiology, 160, 271– 282. https://doi.org/10.1078/0176-1617-00887

Gitelson, A., & Merzlyak, M. N. (1994). Spectral Reflectance Changes Associated with Autumn Senescence of Aesculus hippocastanum L. and Acer platanoides L. Leaves. Spectral Features and Relation to Chlorophyll Estimation. Journal of Plant Physiology, 143, 286– 292. https://doi.org/10.1016/S0176-1617(11)81633-0

Gitelson, A. A., & Merzlyak, M. N. (1998). Remote sensing of chlorophyll concentration in higher plant leaves. Advances in Space Research, 22, 689– 692. https://doi.org/10.1016/S0273-1177(97)01133-2

Gitelson, A. A., Stark, R., Grits, U., Rundquist, D., Kaufman, Y., & Derry, D. (2002). Vegetation and soil lines in visible spectral space: A concept and technique for remote estimation of vegetation fraction. International Journal of Remote Sensing, 23, 2537– 2562. https://doi.org/10.1080/01431160110107806

Godfray, H. C. J., Beddington, J. R., Crute, I. R., Haddad, L., Lawrence, D., Muir, J. F., & Toulmin, C. (2010). Food security: The challenge of feeding 9 billion people. Science, 327, 812– 818. https://doi.org/10.1126/science.1185383

Gonzalez-Dugo, V., Zarco-Tejada, P., Nicolás, E., Nortes, P. A., Alarcón, J. J., Intrigliolo, D. S., & Fereres, E. (2013). Using high resolution UAV Thermal imagery to assess the variability in the water status of five fruit tree species within a commercial orchard. Precision Agriculture, 14, 660– 678. https://doi.org/10.1007/s11119-013-9322-9

Gracia-Romero, A., Kefauver, S. C., Vergara-Díaz, O., Zaman-Allah, M. A., Prasanna, B. M., Cairns, J. E., & Araus, J. L. (2017). Comparative performance of ground VS. aerially assessed RGB and multispectral indices for early-growth evaluation of maize performance under phosphorus fertilization. Frontiers in Plant Science, 8, https://doi.org/10.3389/fpls.2017.02004

Graham, E. A., Yuen, E. M., Robertson, G. F., Kaiser, W. J., Hamilton, M. P., & Rundel, P. W. (2009). Budburst and leaf area expansion measured with a novel mobile camera system and simple color thresholding. Environmental and Experimental Botany, 65, 238– 244. https://doi.org/10.1016/j.envexpbot.2008.09.013

Guilioni, L., Jones, H. G., Leinonen, I., & Lhomme, J. P. (2008). On the relationships between stomatal resistance and leaf temperatures in thermography. Agricultural and Forest Meteorology, 148, 1908– 1912. https://doi.org/10.1016/j.agrformet.2008.07.009

Guo, L., Fu, P., Shi, T., Chen, Y., Zhang, H., Meng, R., & Wang, S. (2020). Mapping field- scale soil organic carbon with unmanned aircraft system-acquired time series multispectral images. Soil and Tillage Research, 196, 104477. https://doi.org/10.1016/j.still.2019.104477

Hagen, N., & Kudenov, M. W. (2013). Review of snapshot spectral imaging technologies. Optical Engineering, 52, 090901. https://doi.org/10.1117/1.oe.52.9.090901

Han, X., Thomasson, J. A., Bagnall, G. C., Pugh, N. A., Horne, D. W., Rooney, W. L., & Cope, D. A. (2018). Measurement and calibration of plant-height from fixed-wing UAV images. Sensors (Basel, Switzerland), 18, 4092. https://doi.org/10.3390/s18124092

Hassan, M. A., Yang, M., Rasheed, A., Yang, G., Reynolds, M., Xia, X., & He, Z. (2019). A rapid monitoring of NDVI across the wheat growth cycle for grain yield prediction using a multi-spectral UAV platform. Plant Science, 282, 95– 103. https://doi.org/10.1016/j.plantsci.2018.10.022

Hassan-Esfahani, L., Torres-Rua, A., Jensen, A., & McKee, M. (2015). Assessment of surface soil moisture using high-resolution multi-spectral imagery and artificial neural networks. Remote Sensing, 7(3), 2627– 2646. https://doi.org/10.3390/rs70302627

Hoffmann, H., Jensen, R., Thomsen, A., Nieto, H., Rasmussen, J., & Friborg, T. (2016). Crop water stress maps for an entire growing season from visible and thermal UAV imagery. Biogeosciences, 13, 6545– 6563. https://doi.org/10.5194/bg-13-6545-2016

Horie, T., Yajima, M., & Nakagawa, H. (1992). Yield forecasting. Agricultural Systems, 40, 211– 236. https://doi.org/10.1016/0308-521X(92)90022-G

Hu, J., Peng, J., Zhou, Y., Xu, D., Zhao, R., Jiang, Q., & Shi, Z. (2019). Quantitative estimation of soil salinity using UAV-borne hyperspectral and satellite multispectral images. Remote Sensing, 11, 736. https://doi.org/10.3390/rs11070736

Huang, H., Deng, J., Lan, Y., Yang, A., Deng, X., Zhang, L., & Chen, P. (2018). A two-stage classification approach for the detection of spider mite-infested cotton using UAV multispectral imagery. Remote Sensing Letters, 9(10), 933– 941. https://doi.org/10.1080/2150704X.2018.1498600

Huete, A. R. (1988). A soil-adjusted vegetation index (SAVI). Remote Sensing of Environment, 25, 295– 309. https://doi.org/10.1016/0034-4257(88)90106-X

Iatrou, G., Mourelatos, S., Gewehr, S., Kalaitzopoulou, S., Iatrou, M., & Zartaloudis, Z. (2017). Using multispectral imaging to improve berry harvest for wine making grapes. Ciencia E Tecnica Vitivinicola, 32, 33– 41. https://doi.org/10.1051/ctv/20173201033

Jackson, R. D., Idso, S. B., Reginato, R. J., & Pinter, P. J. (1981). Canopy temperature as a crop water stress indicator. Water Resources Research, 17, 1133– 1138. https://doi.org/10.1029/WR017i004p01133

Kefauver, S. C., Vicente, R., Vergara-Díaz, O., Fernandez-Gallego, J. A., Kerfal, S., Lopez, A., & Araus, J. L. (2017). Comparative UAV and field phenotyping to assess yield and nitrogen use efficiency in hybrid and conventional barley. Frontiers in Plant Science, 8, 1733. https://doi.org/10.3389/fpls.2017.01733

Kim, D. W., Kim, Y., Kim, K. H., Kim, H. J., & Chung, Y. S. (2019). Case study: Cost- effective weed patch detection by multi-spectral camera mounted on unmanned aerial vehicle in the buckwheat field. Korean Journal of Crop Science, 64(2), 159– 164. https://doi.org/10.7740/kjcs.2019.64.2.159

Křížová, K., Haberle, J., Kroulík, M., Kumhálová, J., & Lukáš, J. (2018). Assessment of soil electrical conductivity using remotely sensed thermal data. Agronomy Research, 16, 784– 793. https://doi.org/10.15159/ar.18.111

Lee, K. J., & Lee, B. W. (2011). Estimating canopy cover from color digital camera image of rice field. Journal of Crop Science and Biotechnology, 14, 151– 155. https://doi.org/10.1007/s12892-011-0029-z

Li, J., Shi, Y., Veeranampalayam-Sivakumar, A. N., & Schachtman, D. P. (2018). Elucidating sorghum biomass, nitrogen and chlorophyll contents with spectral and morphological traits derived from unmanned aircraft system. Frontiers in Plant Science, 9, https://doi.org/10.3389/fpls.2018.01406

Liu, S., Li, L., Gao, W., Zhang, Y., Liu, Y., Wang, S., & Lu, J. (2018). Diagnosis of nitrogen status in winter oilseed rape (Brassica Napus L.) using in-situ hyperspectral data and Unmanned Aerial Vehicle (UAV) multispectral images. Computers and Electronics in Agriculture, 151, 185– 195. https://doi.org/10.1016/j.compag.2018.05.026

Lopez-Granados, F., Torres-Sánchez, J., De Castro, A. I., Serrano-Pérez, A., Mesas-Carrascosa, F. J., & Peña, J. M. (2016). Object-based early monitoring of a grass weed in a grass crop using high resolution UAV imagery. Agronomy for Sustainable Development, 36(4), 67. https://doi.org/10.1007/s13593-016-0405-7

Maes, W. H., & Steppe, K. (2019). Perspectives for remote sensing with unmanned aerial vehicles in precision agriculture. Trends in Plant Science, 24, 152– 164. https://doi.org/10.1016/j.tplants.2018.11.007

Marinello, F., Pezzuolo, A., Chiumenti, A., & Sartori, L. (2016). Technical Analysis of Unmanned Aerial Vehicles (Drones) For Agricultural Applications. Engineering for Rural Development, 25, 870– 875.Retrieved from http://www.tf.llu.lv/conference/proceedings2016/Papers/N164.pdf

Marston, Z. P., Cira, T. M., Hodgson, E. W., Knight, J. F., Macrae, I. V., & Koch, R. L. (2019). Detection of stress induced by soybean aphid (Hemiptera: Aphididae) using multispectral imagery from unmanned aerial vehicles. Journal of Economic Entomology, 113, 779– 786. https://doi.org/10.1093/jee/toz306

Matese, A., Di Gennaro, S. F., & Berton, A. (2017). Assessment of a Canopy Height Model (CHM) in a vineyard using UAV-based multispectral imaging. International Journal of Remote Sensing, 38, 2150– 2160. https://doi.org/10.1080/01431161.2016.1226002

Mattupalli, C., Moffet, C. A., Shah, K. N., & Young, C. A. (2018). Supervised classification of RGB aerial imagery to evaluate the impact of a root rot disease. Remote Sensing, 10, 917. https://doi.org/10.3390/rs10060917

Mekonnen, Y., Namuduri, S., Burton, L., Sarwat, A., & Bhansali, S. (2020). Machine learning techniques in wireless sensor network based precision agriculture. Journal of The Electrochemical Society, 167(3), 037522. https://doi.org/10.1149/2.0222003JES

Melesse, A. M., Weng, Q., Thenkabail, P. S., & Senay, G. B. (2007). Remote sensing sensors and applications in environmental resources mapping and modelling. Sensors, 7, 3209– 3241. https://doi.org/10.3390/s7123209

Meola, C., & Carlomagno, G. M. (2004). Recent advances in the use of infrared thermography. Measurement Science and Technology, 15, 9. https://doi.org/10.1088/0957-0233/15/9/R01

Meyer, G. A., & Whitlow, T. H. (1992). Effects of leaf and sap feeding insects on photosynthetic rates of goldenrod. Oecologia, 92, 480– 489. https://doi.org/10.1007/BF00317839

Oerke, E. C., Steiner, U., Dehne, H. W., & Lindenthal, M. (2006). Thermal imaging of cucumber leaves affected by downy mildew and environmental conditions. Journal of Experimental Botany, 57, 2121– 2132. https://doi.org/10.1093/jxb/erj170

Osco, L. P., Marques Ramos, A. P., Saito Moriya, É. A., de Souza, M., Marcato Junior, J., Matsubara, E. T., & Creste, J. E. (2019). Improvement of leaf nitrogen content inference in valencia-orange trees applying spectral analysis algorithms in UAV mounted- sensor images. International Journal of Applied Earth Observation and Geoinformation, 83, 101907. https://doi.org/10.1016/j.jag.2019.101907

Ostos-Garrido, F. J., De Castro, A. I., Torres-Sánchez, J., Pistón, F., & Peña, J. M. (2019). High- throughput phenotyping of bioethanol potential in cereals by using UAV-based multi-spectral imagery. Frontiers in Plant Science, 10, 948. https://doi.org/10.3389/fpls.2019.00948

Pena, J. M., Torres-Sánchez, J., De Castro, A. I., Kelly, M., & López-Granados, F. (2013). Weed mapping in early-season maize fields using object-based analysis of Unmanned Aerial Vehicle (UAV) images. PLOS ONE, 8(10). e77151. https://doi.org/10.1371/journal.pone.0077151

Perez-Ortiz, M., Peña, J. M., Gutiérrez, P. A., Torres-Sánchez, J., Hervás-Martínez, C., & López- Granados, F. (2015). A semi-supervised system for weed mapping in sunflower crops using unmanned aerial vehicles and a crop row detection method. Applied Soft Computing, 37, 533– 544. https://doi.org/10.1016/j.asoc.2015.08.027

Pinter, P. J., Jackson, R. D., & Moran, M. S. (1990). Bidirectional reflectance factors of agricultural targets: A comparison of ground-, aircraft-, and satellite-based observations. Remote Sensing of Environment, 32, 215– 228. https://doi.org/10.1016/0034-4257(90)90019-I

Quebrajo, L., Perez-Ruiz, M., Pérez-Urrestarazu, L., Martínez, G., & Egea, G. (2018). Linking thermal imaging and soil remote sensing to enhance irrigation management of sugar beet. Biosystems Engineering, 165, 77– 87. https://doi.org/10.1016/j.biosystemseng.2017.08.013

Raun, W. R., Solie, J. B., Johnson, G. V., Stone, M. L., Lukina, E. V., Thomason, W. E., & Schepers, J. S. (2001). In-season prediction of potential grain yield in winter wheat using canopy reflectance. Agronomy Journal, 93, 131– 138. https://doi.org/10.2134/agronj2001.931131x

Rembold, F., Atzberger, C., Savin, I., & Rojas, O. (2013). Using low resolution satellite imagery for yield prediction and yield anomaly detection. Remote Sensing, 5, 1704– 1733. https://doi.org/10.3390/rs5041704

Santesteban, L. G., Di Gennaro, S. F., Herrero-Langreo, A., Miranda, C., Royo, J. B., & Matese, A. (2017). High-resolution UAV-based thermal imaging to estimate the instantaneous and seasonal variability of plant water status within a vineyard. Agricultural Water Management, 183, 49– 59. https://doi.org/10.1016/j.agwat.2016.08.026

Sarkar, T. K., Ryu, C. S., Kang, Y. S., Kim, S. H., Jeon, S. R., Jang, S. H., & Kim, H. J. (2018). Integrating UAV remote sensing with GIS for predicting rice grain protein. Journal of Biosystems Engineering, 43(2), 148– 159. https://doi.org/10.5307/JBE.2018.43.2.148

Serrano, L., Peñuelas, J., & Ustin, S. L. (2002). Remote sensing of nitrogen and lignin in Mediterranean vegetation from AVIRIS Data: Decomposing biochemical from structural signals. Remote Sensing of Environment, 81, 355– 364. https://doi.org/10.1016/S0034-4257(02)00011-1

Severtson, D., Callow, N., Flower, K., Neuhaus, A., Olejnik, M., & Nansen, C. (2016). Unmanned aerial vehicle canopy reflectance data detects potassium deficiency and green peach aphid susceptibility in Canola. Precision Agriculture, 17, 659– 677. https://doi.org/10.1007/s11119-016-9442-0

Shanahan, J. F., Schepers, J. S., Francis, D. D., Varvel, G. E., Wilhelm, W. W., Tringe, J. M., & Major, D. J. (2001). Use of remote-sensing imagery to estimate corn grain yield. Agronomy Journal, 93, 583– 589. https://doi.org/10.2134/agronj2001.933583x

Stanton, C., Starek, M. J., Elliott, N., Brewer, M., Maeda, M. M., & Chu, T. (2017). Unmanned aircraft system-derived crop height and normalized difference vegetation index metrics for sorghum yield and aphid stress assessment. Journal of Applied Remote Sensing, 11, 026035. https://doi.org/10.1117/1.JRS.11.026035

Su, J., Coombes, M., Liu, C., Zhu, Y., Song, X., Fang, S., & Chen, W. H. (2019). Machine learning-based crop drought mapping system by UAV remote sensing RGB imagery. Unmanned Systems, 08, 71– 83. https://doi.org/10.1142/S2301385020500053

Su, J., Liu, C., Coombes, M., Hu, X., Wang, C., Xu, X., & Chen, W. H. (2018). Wheat yellow rust monitoring by learning from multispectral UAV aerial imagery. Computers and Electronics in Agriculture, 155, 157– 166. https://doi.org/10.1016/j.compag.2018.10.017

Sugiura, R., Tsuda, S., Tamiya, S., Itoh, A., Nishiwaki, K., Murakami, N., & Nuske, S. (2016). Field phenotyping system or the assessment of potato late blight resistance using RGB imagery from an unmanned aerial vehicle. Biosystems Engineering, 148, 1– 10. https://doi.org/10.1016/j.biosystemseng.2016.04.010

Torres-Sánchez, J., López-Granados, F., De Castro, A. I., & Peña-Barragán, J. M. (2013). Configuration and Specifications of An Unmanned Aerial Vehicle (UAV) For Early Site Specific Weed Management. PLOS ONE, 8, e58210. https://doi.org/10.1371/journal.pone.0058210

Torres-Sánchez, J., López-Granados, F., Serrano, N., Arquero, O., & Peña, J. M. (2015). High- throughput 3-D Monitoring of Agricultural-Tree Plantations with Unmanned Aerial Vehicle (UAV) technology. PLOS ONE, 10, e0130479. https://doi.org/10.1371/journal.pone.0130479

Tucker, C. J. (1979). Red and photographic infrared linear combinations for monitoring vegetation. Remote Sensing of Environment, 8, 127– 150. https://doi.org/10.1016/0034-4257(79)90013-0

Vanegas, F., Bratanov, D., Powell, K., Weiss, J., & Gonzalez, F. (2018). A novel methodology for improving plant pest surveillance in vineyards and crops using UAV-based hyperspectral and spatial data. Sensors (Switzerland), 18, 260. https://doi.org/10.3390/s18010260

Vašát, R., Heuvelink, G. B. M., & Borůvka, L. (2010). Sampling design optimization for multivariate soil mapping. Geoderma, 155, 147– 153. https://doi.org/10.1016/j.geoderma.2009.07.005

Wahab, I., Hall, O., & Jirström, M. (2018). Remote sensing of yields: Application of UAV Imagery-Derived NDVI for estimating maize vigor and yields in complex farming systems in Sub-Saharan Africa. Drones, 2, 28. https://doi.org/10.3390/drones2030028

Walsh, O. S., Shafian, S., Marshall, J. M., Jackson, C., McClintick-Chess, J. R., Blanscet, S. M., & Walsh, W. L. (2018). Assessment of UAV based vegetation indices for nitrogen concentration estimation in spring wheat. Advances in Remote Sensing, 07, 71– 90. https://doi.org/10.4236/ars.2018.72006

Wang, H., Mortensen, A. K., Mao, P., Boelt, B., & Gislum, R. (2019). Estimating the nitrogen nutrition index in grass seed crops using a UAV-mounted multispectral camera. International Journal of Remote Sensing, 40, 2467– 2482. https://doi.org/10.1080/01431161.2019.1569783

Wang, L., Tian, Y., Yao, X., Zhu, Y., & Cao, W. (2014). Predicting grain yield and protein content in wheat by fusing multi-sensor and multi-temporal remote-sensing images. Field Crops Research, 164, 178– 188. https://doi.org/10.1016/j.fcr.2014.05.001

Wigmore, O., Mark, B., McKenzie, J., Baraer, M., & Lautz, L. (2019). Sub-metre mapping of surface soil moisture in proglacial valleys of the tropical Andes using a multispectral unmanned aerial vehicle. Remote Sensing of Environment, 222, 104– 118. https://doi.org/10.1016/j.rse.2018.12.024

Yang, G., Liu, J., Zhao, C., Li, Z., Huang, Y., Yu, H., & Zhang, R. (2017). Unmanned aerial vehicle remote sensing for field-based crop phenotyping: Current status and perspectives. Frontiers in Plant Science, 8, 1111. https://doi.org/10.3389/fpls.2017.01111

Zarco-Tejada, P. J., González-Dugo, V., & Berni, J. A. J. (2012). Fluorescence, temperature and narrow-band indices acquired from A UAV platform for water stress detection using a micro-hyperspectral imager and a thermal camera. Remote Sensing of Environment, 117, 322– 337. https://doi.org/10.1016/j.rse.2011.10.007

Zhang, D., Zhou, X., Zhang, J., Lan, Y., Xu, C., & Liang, D. (2018). Detection of rice sheath blight using an unmanned aerial system with high-resolution color and multispectral imaging. PLOS ONE, 13(5), e0187470. https://doi.org/10.1371/journal.pone.0187470

Zhang, L., Zhang, H., Niu, Y., & Han, W. (2019). Mapping maize water stress based on UAV multispectral remote sensing. Remote Sensing, 11, 605. https://doi.org/10.3390/rs11060605

Zhang, N., Zhang, X., Yang, G., Zhu, C., Huo, L., & Feng, H. (2018). Assessment of defoliation during the Dendrolimus Tabulaeformis Tsai Et Liu disaster outbreak using UAV-based hyperspectral images. Remote Sensing of Environment, 217, 323– 339. https://doi.org/10.1016/j.rse.2018.08.024

Zheng, H., Cheng, T., Li, D., Yao, X., Tian, Y., Cao, W., & Zhu, Y. (2018). Combining Unmanned Aerial Vehicle (UAV)-based multispectral imagery and ground-based hyperspectral data for plant nitrogen concentration estimation in rice. Frontiers in Plant Science, 9, https://doi.org/10.3389/fpls.2018.00936

Zpracoval: Ing. Jan Lukáš, Ph.D. Výzkumný ústav rostlinné výroby, v. v. i. lukas@vurv.cz